Recent Posts

- DPIA e FRIA nei sistemi di IA: cosa cambia e come integrarle

- NIS2 e gestione dei fornitori. Attenzione alla governance della fornitura

- Significato di trasparenza e spiegabilità di un sistema di IA e conseguenze legali

- Determina ACN 9 febbraio 2026: tassonomia degli incidenti e obblighi di segnalazione NIS2

- Cybersicurezza e NIS2: scopri se sei un soggetto obbligato

Recent Comments

Significato di trasparenza e spiegabilità di un sistema di IA e conseguenze legali

La necessità di un’IA affidabile

La recente popolarità dei sistemi di IA (in particolare degli LLM), degli agenti di IA e, più in generale, degli strumenti e delle applicazioni basati sull’IA sta portando a un utilizzo massiccio di tale tecnologia in tutti gli ambiti delle nostre interazioni sociali. Ciò include qualsiasi tipo di attività d’impresa, i social network, la vita personale e così via.

Oltre alle questioni relative al potere politico acquisito dagli sviluppatori di tali sistemi, una grande attenzione è rivolta ai rischi connessi all’uso dei sistemi di IA e ai conseguenti incidenti.

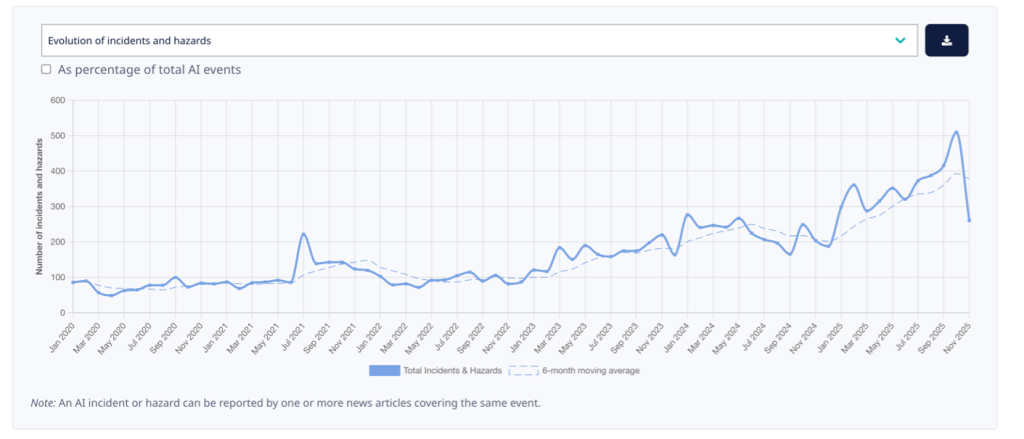

Se siete curiosi di approfondire i rischi, gli incidenti e i pericoli tipicamente collegati all’uso dei sistemi di IA, potete consultare il MIT AI Risk Repository oppure la pagina dell’OECD dedicata all’AI Incidents and Hazards Monitor.

Quest’ultima mostra in modo piuttosto chiaro come il numero di incidenti legati all’IA stia aumentando rapidamente con l’impennata dell’uso dei sistemi di IA:

Al fine di garantire che tali rischi siano contenuti durante lo sviluppo, l’addestramento e l’uso dei sistemi di IA, diversi attori a livello globale hanno sviluppato framework e principi di gestione del rischio. Le misure e i principi elaborati mirano a stimolare l’uso di una “IA affidabile”: tale termine si riferisce a “caratteristiche che aiutano gli stakeholder rilevanti a comprendere se il sistema di IA soddisfa le loro aspettative” (cfr. ISO/IEC 22989:2022(E)).

Affinché i sistemi di IA siano considerati affidabili, essi devono spesso soddisfare una serie di criteri rilevanti per diversi stakeholder. Sebbene tali criteri possano talvolta influenzarsi a vicenda e comportare compromessi, il rafforzamento dell’affidabilità dell’IA in generale contribuisce a mitigare i rischi negativi.

Di norma, le caratteristiche dell’affidabilità sono strettamente intrecciate con le pratiche sociali e organizzative; i dati utilizzati per addestrare e far funzionare i sistemi di IA; la scelta dei modelli e degli algoritmi; le decisioni di progettazione e governance adottate dagli sviluppatori; e i modi in cui gli esseri umani contribuiscono con competenza, supervisione e responsabilità durante il deployment.

Il giudizio umano è essenziale nella selezione delle metriche utilizzate per valutare tali caratteristiche e nella definizione dei valori-soglia specifici che tali metriche devono soddisfare.

Principi di un’IA affidabile

Sebbene diversi framework di rischio per l’IA possano attribuire un valore diverso alle caratteristiche di un’IA affidabile (ad esempio, attribuendo maggiore o minore peso alla privacy), vi è una generale coerenza tra i documenti e le linee guida pubblicati a livello globale.

I principi tipici di un’IA affidabile includono (i) equità, (ii) sicurezza, (iii) privacy e sicurezza informatica, (iv) trasparenza, (v) spiegabilità, (vi) accountability.

Il concetto di “trasparenza”

Il termine “trasparenza” ha una natura ampia e implica una certa flessibilità, poiché il suo significato può variare a seconda del contesto. In generale, comporta la comunicazione agli stakeholder di informazioni adeguate sul sistema di IA. Ciò può includere, ad esempio, la spiegazione del funzionamento del sistema, i dettagli relativi al mantenimento della documentazione tecnica e non tecnica lungo il ciclo di vita dell’IA, gli obiettivi e le limitazioni, le scelte progettuali, i modelli e così via.

Insieme alle informazioni strettamente relative al sistema, gli obblighi di trasparenza e le best practice includono anche l’informazione dello stakeholder in relazione ai dati utilizzati nello sviluppo (ad esempio, dati di addestramento, validazione e test).

È importante notare che, di norma, trasparenza non significa un obbligo di divulgare il codice sorgente o altro codice proprietario o dataset proprietari, ma piuttosto consentire alle persone di comprendere come un sistema di IA viene sviluppato, addestrato, distribuito e come funziona in determinati usi o ambienti.

Il concetto di “spiegabilità”

L’idea di spiegabilità differisce dal concetto di trasparenza. In particolare, essa si riferisce allo spiegare agli utenti come il sistema di IA produce un determinato output o prende una specifica decisione. Ciò significa fornire agli stakeholder informazioni chiare e accessibili affinché possano comprendere quali elementi hanno condotto a un determinato esito e in che modo le persone (negativamente) interessate dall’esito possano contestarlo.

Trasparenza e spiegabilità sono entrambi elementi che consentono un’IA più affidabile, ma non sono sinonimi. Mentre la trasparenza riguarda la descrizione del sistema (sia negli aspetti tecnici sia in quelli non tecnici), la spiegabilità riguarda specificamente la descrizione di come il sistema passa dall’input all’output e di quali fattori influenzano l’esito.

Di conseguenza, un sistema può anche essere trasparente ma non spiegabile, o viceversa.

Cosa fare in pratica

I fornitori che operano in Europa o con clienti europei saranno vincolati ai principi di trasparenza e spiegabilità da norme giuridiche vincolanti, ossia dall’AI Act. Tale regolamento impone l’obbligo di progettare e sviluppare sistemi di IA ad alto rischio “in modo tale da garantire che il loro funzionamento sia sufficientemente trasparente da consentire ai deployer di interpretare l’output del sistema e utilizzarlo adeguatamente”. In particolare, ai sensi dell’art. 13, par. 3, dell’AI Act, tali sistemi di IA ad alto rischio devono essere accompagnati da un insieme di istruzioni che forniscano un’ampia gamma di informazioni ai deployer in merito al fornitore, al sistema stesso e ai dati (di addestramento, validazione e test), nonché informazioni che consentano ai deployer di interpretare l’output.

Analogamente, l’art. 50 dell’AI Act impone determinati obblighi di trasparenza ai fornitori e ai deployer di determinati sistemi di IA che espongono il pubblico a rischi particolari. Ad esempio, i fornitori di sistemi di IA che interagiscono direttamente con il pubblico o i deployer di sistemi di IA che generano o manipolano contenuti di immagini, audio o video che costituiscono un deep fake devono informare il pubblico che sta interagendo con un sistema di IA o con contenuti generati dall’IA.

Per le imprese è fondamentale essere in grado di mostrare e spiegare il sistema di IA, i dati che utilizza, come funziona e come giunge agli esiti. Ciò avviene tipicamente tramite documentazione e spiegazioni di facile comprensione (ossia documenti, diagrammi e così via).

Comments are closed.